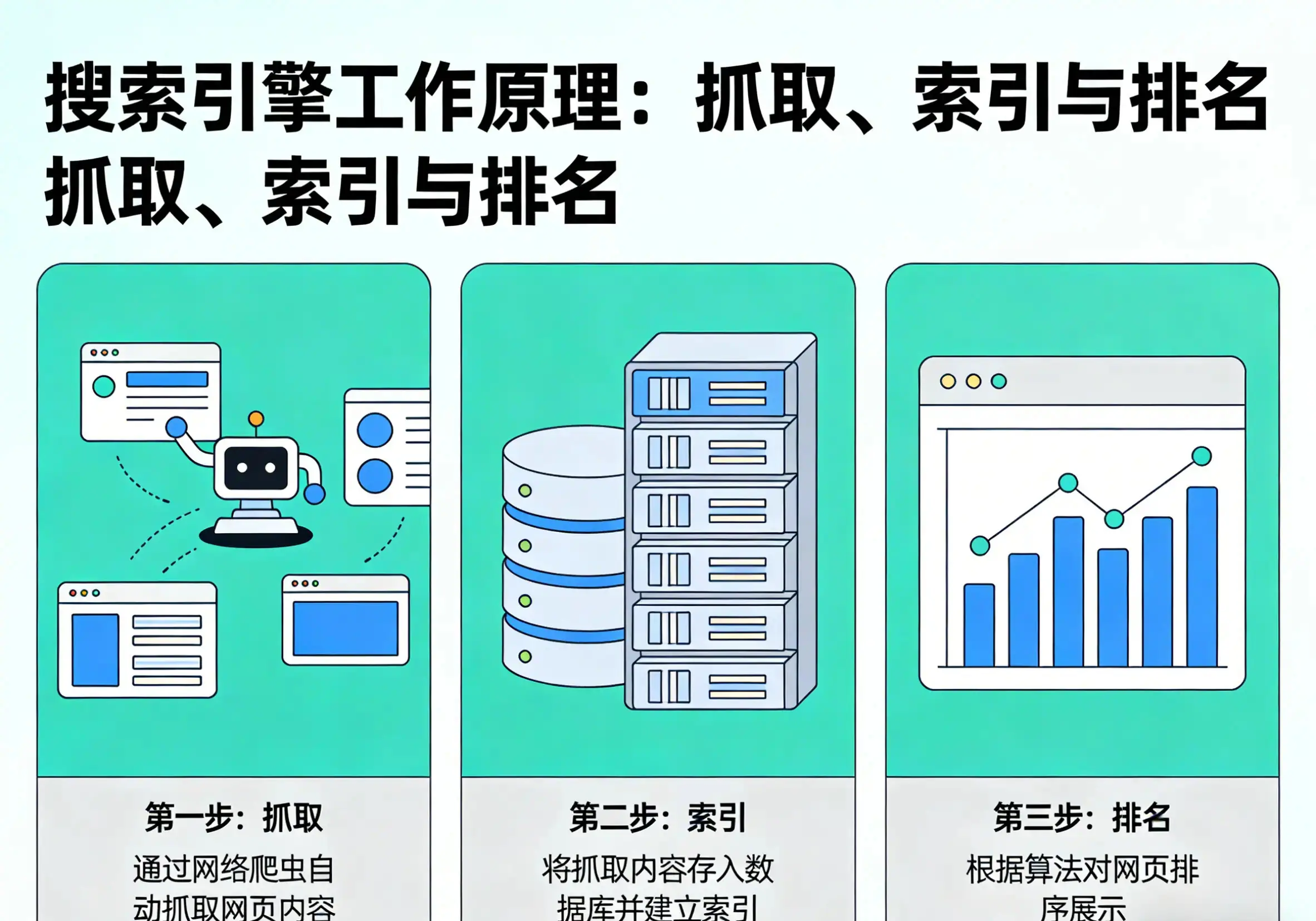

搞懂这三步,你就掌握了SEO的核心底层逻辑,知道该怎么优化才能让搜索引擎“喜欢”你的网站,让更多客户找到你。毕竟,做SEO就像追客户,得先知道客户的“喜好和习惯”,才能投其所好。在深入拆解前,先跟大家回顾下核心:什么是SEO?本质就是顺着搜索引擎的工作逻辑,优化自己的网站,让它在“抓取、索引、排名”三个环节都能脱颖而出。今天就用大白话+生活化比喻,把搜索引擎的工作原理讲透,小白也能一听就懂、一学就会。

一、核心总览:搜索引擎的“工作闭环”,就3步搞定

咱们先给搜索引擎定个“身份”:它就像一个“超级图书馆管理员”,手里管着互联网上几十亿、上百亿的网页(相当于图书馆里的书)。用户搜索关键词,就相当于去图书馆找书,而搜索引擎的工作,就是快速从海量“书籍”里,找出最符合你需求的那几本,按“靠谱程度”排序递到你面前。这个“找书、存书、递书”的过程,就是搜索引擎的核心工作流程——抓取、索引、排名,三步环环相扣,缺一不可。任何一步出问题,你的网站都可能无法被用户找到,这也是很多企业做SEO没效果的核心原因。如果想系统学习如何配合这三步做优化,可以参考SEO基础指南,从基础操作入手,避开优化误区。

.webp)

二、分步拆解:搜索引擎工作三步曲(小白必懂)

2.1 第一步:抓取——互联网的“巡逻队”,地毯式找网页

抓取,就是搜索引擎派出“巡逻队”,在互联网上“地毯式”寻找新的、更新的网页,把它们的“地址”(URL)记下来,带回自己的“服务器仓库”。这个“巡逻队”有个专业名字,叫“爬虫”(也叫Spider、Bot),它就像不知疲倦的侦察兵,24小时不停歇,顺着网页里的链接(内链、外链)到处爬,发现新网页就记录,发现旧网页更新了就重新记录。举个生活化的例子:这就像小区里的快递员,每天穿梭在各个楼栋、各个楼层,挨家挨户送快递、收快递——不管你是新搬来的住户(新网页),还是老住户有新快递(旧网页更新),他都会精准找到你家地址,做好记录。

这里有个关键知识点,小白一定要记好:爬虫能不能顺利找到你的网站,关键看两个东西——网站结构和Sitemap与Robots.txt。如果你的网站结构像迷宫一样,页面之间没有链接,爬虫就会“迷路”,找不到你的核心页面;如果Robots.txt设置错误,相当于你给爬虫“贴了禁止入内”的牌子,它就算走到你网站门口,也会转身离开,导致你的网页无法被抓取。

另外要注意:爬虫的“精力”是有限的,不会把互联网上所有网页都抓取下来。那些内容质量低、重复度高、链接混乱的网页,爬虫会直接忽略,就像快递员不会收寄空包裹、破损包裹一样。

2.2 第二步:索引——巨大的“图书馆目录”,给网页分类存档

抓取到网页后,搜索引擎不会直接把网页呈现给用户,而是会对这些网页进行“加工处理”,然后分类存档,这个过程就叫“索引”。简单说,索引就是给抓取来的网页做“标签”“分类”,建立一个巨大的“图书馆目录”,方便后续用户搜索时,能快速找到对应的网页。还是用“图书馆”比喻:爬虫把“书籍”(网页)带回图书馆后,管理员(搜索引擎)不会直接把书堆在角落,而是会先翻看这本书的内容,提炼核心信息——比如书名(网页标题)、作者(网站主体)、核心内容(网页正文)、关键词(核心话题),然后给这本书贴好标签,分到对应的书架(分类目录)里,比如“SEO基础”“电商运营”“美食教程”等。

这里有个小白容易踩的坑:不是所有被抓取的网页,都会被索引。就像图书馆管理员不会收录内容杂乱、字迹潦草、毫无价值的书一样,搜索引擎也会筛选网页——如果你的网页内容抄袭、重复度高、没有实际价值,或者加载速度极慢,就算被爬虫抓取,也会被“拒绝索引”,无法进入“图书馆目录”,自然也就无法参与后续的排名,用户根本搜不到。

而优质的网页,会被搜索引擎精准提炼核心信息、打上清晰标签,存入索引库,相当于这本书被管理员好好整理,放进了显眼的书架,后续用户找相关书籍时,就能快速被找到。这也是为什么SEO优化中,强调“优质原创内容”的核心原因——只有这样,才能顺利通过“索引”这一关。

2.3 第三步:排名——智能“评分系统”,给网页排先后

当用户在搜索引擎输入关键词(比如“小白如何做SEO”“本地家政公司”),搜索引擎就会从“索引库”(图书馆目录)里,筛选出所有和这个关键词相关的网页,然后通过一套复杂的“评分系统”,给这些网页排先后顺序,把最符合用户需求、最优质的网页排在前面,这就是“排名”。这个“评分系统”,就是搜索引擎的核心算法(比如百度算法、谷歌算法),它就像图书馆管理员的“选书标准”——同样是找“SEO基础”相关的书,管理员会优先推荐内容权威、排版清晰、读者评价好的书,而不是内容杂乱、毫无营养的书。

搜索引擎的排名算法有上百个评分因素,比如网页的相关性、权威性、用户体验、内容新鲜度等,这些因素共同决定了网页的排名高低(具体可参考SEO排名因素,了解更多评分细节)。简单来说,核心就是两点:一是你的网页内容,是否真正满足用户的搜索需求;二是你的网页,是否比其他竞争对手的网页更优质、更权威。

举个例子:用户搜索“小白学SEO”,搜索引擎会从索引库中筛选出所有和“小白学SEO”相关的网页,然后打分排序——那些内容原创、讲解通俗易懂、网站加载快、移动端适配好、有很多优质外链推荐(权威背书)的网页,会排在首页;而那些内容抄袭、排版混乱、加载缓慢的网页,会排在几十页、上百页之后,用户基本不会看到。

这里要提醒小白:搜索引擎的算法不是一成不变的,会定期更新(比如百度每年会有多次核心算法更新),就像图书馆管理员会不断调整选书标准一样。所以做SEO不能一成不变,要持续优化,跟上算法更新的节奏,才能稳定排名。

三、小白必看:搞懂原理,才能做好SEO(避坑关键)

很多小白做SEO,只知道“要优化排名”,却不知道搜索引擎的工作原理,盲目堆砌关键词、乱发外链,最后不仅没效果,还可能被搜索引擎惩罚。其实搞懂“抓取、索引、排名”三步原理后,你就知道该从哪里下手优化了:1. 针对“抓取”:优化网站结构,让爬虫“走得通”;正确设置Sitemap与Robots.txt,让爬虫“进得来、找得全”;多做优质内链和外链,给爬虫“指路”,让它能快速找到你的核心页面。

2. 针对“索引”:创作优质原创内容,避免抄袭和重复;优化网页标题、关键词,让搜索引擎能快速提炼核心信息;提升网页加载速度,改善用户体验,让搜索引擎愿意收录你的网页。

3. 针对“排名”:精准匹配用户搜索意图,让网页内容真正解决用户需求;提升网站权威性,积累优质外链;做好移动端适配,优化用户浏览体验;持续更新内容,保持网页新鲜度,跟上算法更新节奏。

如果还是不知道具体该怎么操作,可以先从SEO基础指南学起,先搞懂什么是SEO,再结合搜索引擎的工作原理,一步一个脚印做优化,慢慢就能看到效果。

四、总结:原理不难,找对方法就能做好

总结一下,搜索引擎的工作原理其实很简单,就是“抓取→索引→排名”三步闭环:爬虫抓取网页地址,搜索引擎加工索引存档,用户搜索时按算法排名呈现。搞懂这三步,你就看透了SEO的本质——不是“投机取巧”,而是顺着搜索引擎的“喜好”,优化自己的网站,让它在每一个环节都能脱颖而出。对于小白企业主来说,不用害怕搜索引擎的“神秘”,也不用追求“速成”。先吃透这个核心原理,再配合正确的优化方法,持续打磨内容、优化网站,慢慢就能让搜索引擎“重视”你的网站,让你的网站排名越来越高,获得更多精准自然流量。

记住,SEO的核心是“用户价值”,搜索引擎的所有工作,都是为了把最有价值的内容推给最需要的用户。只要你始终围绕“用户需求”做优化,遵循搜索引擎的工作逻辑,就一定能做好SEO,让网站成为企业获客的“长期资产”。

- 上一篇: SEO的主要分类:白帽、黑帽与灰帽

- 下一篇: SEO排名因素有哪些?小白必看的核心排名算法全解